เรื่องโดย รวิศ ทัศคร

เมตาเลนส์ (metalens) เป็นเลนส์แบนบางที่ประกอบด้วยโครงสร้างนาโนขนาดเล็กบนพื้นผิว ซึ่งจัดเรียงในรูปแบบเฉพาะเพื่อปรับเปลี่ยนเฟสของแสงที่ผ่านไปได้อย่างแม่นยำ แตกต่างจากเลนส์แก้วแบบเดิมที่ใช้การโค้งผิวเพื่อหักเหแสง

วัสดุเมตา (metamaterials) ที่ใช้ในเมตาเลนส์มีคุณสมบัติทางแสงที่ไม่พบในวัสดุธรรมชาติ เช่น การตอบสนองแสงแบบแอนไอโซทรอปิก (anisotropic optical response) ซึ่งทำให้วัสดุมีปฏิสัมพันธ์กับแสงแตกต่างกันตามทิศทางการผ่านของแสง ไม่ว่าจะเป็นการหักเห โปร่งแสง หรือความเร็วของแสงที่แปรผันไปตามแกนของวัสดุ นอกจากนี้เมตาเลนส์ยังควบคุมเฟสของแสงได้ในระดับนาโน ส่งผลให้รวมฟังก์ชันการทำงานของเลนส์หลายชิ้นไว้ในชั้นเดียวที่บางและแบนเป็นพิเศษ จึงเป็นเทคโนโลยีที่มีศักยภาพสำหรับอุปกรณ์ทางทัศนศาสตร์ในอนาคต

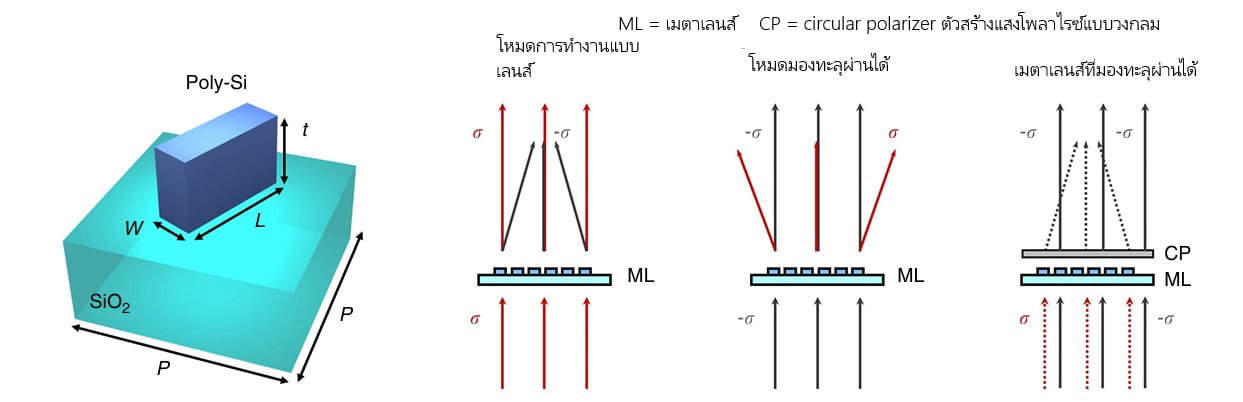

แสดงแนวคิดการนำเอาวัสดุที่มีพื้นผิวแบบเมตา ร่วมกับจอแสดงผลแบบใสที่มองทะลุได้ไปใส่รวมกับคอนแทกต์เลนส์

เพื่อให้ได้เลนส์ที่มีมุมมองกว้าง (wide field of view: FOV) และมีขนาดใหญ่พอเหมาะสำหรับการใช้งานเป็นเลนส์ใกล้ตาแบบส่องผ่าน (transmission-type eyepiece) ในระบบเออาร์ (augmented reality: AR) จึงใช้งานวัสดุพื้นผิวแบบเมตา (metasurface) ซึ่งเป็นอาร์เรย์สองมิติของโครงสร้างนาโน หรือที่เรียกว่า เมตาอะตอม (meta-atoms) ซึ่งมีขนาดเล็กกว่าความยาวคลื่นของแสง โดยทั่วไปแล้วพื้นผิวแบบเมตาจะประกอบด้วยอาร์เรย์สองมิติของตัวกระจายแสงที่มีขนาดเล็กกว่าความยาวคลื่น เมตาอะตอมเหล่านี้ออกแบบมาให้มีคุณสมบัติทางแสงที่โดดเด่นสำหรับการควบคุมแอมพลิจูด เฟส โพลาไรเซชัน หรือสเปกตรัมของแสงในเชิงพื้นที่ คุณสมบัติทางแสงของพื้นผิวแบบเมตาจะเป็นไปตามรูปทรงเรขาคณิตหรือวัสดุของเมตาอะตอมซึ่งไม่เคยมีมาก่อน รวมทั้งไม่พบในวัสดุที่มีอยู่ในธรรมชาติ

ด้วยเหตุนี้คอนแทกต์เลนส์ที่ทำจากวัสดุพื้นผิวแบบเมตาจึงมีศักยภาพในการปฏิวัติการแก้ไขสายตาด้วยการเอาชนะข้อจำกัดของคอนแทกต์เลนส์แบบดั้งเดิม และด้วยความสามารถในการปรับแต่งแสงในระดับย่อยความยาวคลื่น วัสดุพื้นผิวแบบเมตาจึงให้ความคมชัดในการมองเห็นที่ดีขึ้น ให้การรับรู้สีที่เพิ่มขึ้น หรือแม้กระทั่งซ้อนทับภาพแบบเออาร์กับโลกความเป็นจริงที่อยู่รอบตัวผู้ใช้งานก็ทำได้

โครงสร้างและหลักการทำงานของเมตาเลนส์

โครงสร้างพื้นฐานของเมตาเลนส์นี้ประกอบด้วย โครงสร้างรูปแท่งขนาดนาโน (nanorod) หรือเรียกทับศัพท์ว่า “นาโนร็อด” รูปสี่เหลี่ยมผืนผ้าที่วางตัวในมุมต่าง ๆ ตามตำแหน่งของแต่ละหน่วยบนพื้นผิวของพื้นผิวเมตา แสงที่ตกกระทบเมตาเลนส์ซึ่งเป็นแสงโพลาไรซ์แบบวงกลม (circularly polarized light: CPL) จะมีการส่องผ่านที่แตกต่างกันไปตามมุมวางของแท่งนาโนร็อด โดยแบ่งออกเป็นสองส่วน คือ ส่วนแสงที่มีขั้วเดียวกันกับแสงเข้ามา (co-polarized component) และส่วนแสงที่มีขั้วตรงข้ามกับแสงเข้ามา (cross-polarized component)

โดย co-polarized จะได้รับการเปลี่ยนเฟสที่ขึ้นอยู่กับมุมวางของนาโนร็อดเท่านั้น ซึ่งเรียกกันว่า Pancharatnam-Berry phase (เฟสพันชารัตนัม-เบร์รี) หรือเฟสเรขาคณิต (geometric phase) ซึ่งเป็นเฟสที่ไม่ขึ้นกับความยาวคลื่นของแสง ทำให้เมตาเลนส์นี้มีคุณสมบัติส่งผ่านช่วงความถี่ได้กว้าง

ค่าการส่งผ่านแสงของทั้ง co-polarized และ cross-polarized จะขึ้นกับขนาดของนาโนร็อดทั้งความยาวและความกว้าง รวมถึงความหนาของนาโนร็อด โดยถ้าหากนาโนร็อดมีคุณสมบัติส่งผ่านแสงทั้งสองขั้วเหมือนกัน (isotropic) ส่วน cross-polarized จะหายไป และถ้าค่าการส่งผ่านแสงมีเฟสที่ตรงข้ามกันแต่มีความเข้มเท่ากัน ส่วน co-polarized จะหายไป

ดังนั้นการออกแบบนาโนร็อดอย่างเหมาะสมจะช่วยให้เราควบคุมได้อย่างอิสระทั้งส่วน co-polarized และ cross-polarized ซึ่งสำคัญมากสำหรับการสร้างเมตาเลนส์ที่ใช้สำหรับแสดงผลเออาร์ที่ต้องการให้ผู้ใช้มองเห็นโลกจริง (ผ่าน co-polarized ที่ต้องส่งผ่านสูงและสม่ำเสมอ) และภาพเสมือน (cross-polarized ที่ต้องโฟกัส) พร้อมกัน

การทำงานของเมตาเลนส์ในระบบ AR

เมื่อติดตั้งเมตาเลนส์ไว้หน้าดวงตาผู้ใช้ แสงโพลาไรซ์แบบวงกลมที่มีขั้วหนึ่ง (σ) จะแบ่งออกเป็นสองส่วน แสง cross-polarized จะถูกเลนส์นี้รวมไว้เพื่อสร้างภาพเสมือน ขณะที่แสง co-polarized จะผ่านเลนส์ไปได้เหมือนแสงธรรมดาส่องผ่านกระจก

ในทางกลับกัน แสงโพลาไรซ์แบบวงกลมที่มีขั้วตรงข้ามกัน (−σ) ส่วนของแสง cross-polarized จะถูกเลนส์ทำให้แสงกระจายออก ขณะที่แสง co-polarized จะผ่านเลนส์ไปได้เหมือนแสงธรรมดาส่องผ่านกระจกเช่นกัน

ถ้าเรากรองแสงด้วยอุปกรณ์ที่เรียกว่า โพลาไรเซอร์แบบวงกลม (circular polarizer) เพื่อกรองขั้วหนึ่งออกไป จะเหลือแสงที่รวมแสงจากขั้วหนึ่งกับแสงที่ผ่านโดยตรงจากขั้วตรงข้ามซึ่งทำให้ระบบแยกภาพเสมือนและภาพโลกจริงได้ชัดเจน เกิดเป็น transmission-type eyepiece ที่ทั้งแสดงภาพเสมือนและเห็นโลกจริงได้พร้อมกัน เมตาเลนส์จึงทำหน้าที่สองอย่าง คือ เป็นเลนส์สำหรับสร้างภาพของโลกเสมือน (virtual information) ให้ปรากฏแก่ตาผู้ใช้งาน และทำหน้าที่เป็นกระจกใสสำหรับให้ผู้ใช้งานมองเห็นฉากในโลกแห่งความจริงภายนอกไปพร้อม ๆ กัน

มีงานวิจัยที่ใช้ซอฟต์แวร์มัลติฟิสิกส์ยอดนิยม “COMSOL” คำนวณด้วยวิธีไฟไนต์เอลิเมนต์ (finite element method: FEM) เพื่อจำลองและออกแบบนาโนร็อดที่ทำจากพอลิคริสตัลไลน์ซิลิคอน (poly-crystalline silicon: Poly-Si) ซึ่งมีความเข้ากันได้กับกระบวนการผลิตแบบซีมอส (CMOS) ทำให้สามารถผลิตได้ในระดับอุตสาหกรรม ขนาดนาโนร็อดถูกกำหนดไว้ที่ความยาว 220 นาโนเมตร ความกว้าง 60 นาโนเมตร ความหนา 100 นาโนเมตร โดยหน่วยเซลล์มีระยะห่าง 400 นาโนเมตร เพื่อให้ได้ประสิทธิภาพการส่งผ่านแสง co-polarized สูงและสม่ำเสมอในช่วงความยาวคลื่นที่มองเห็นได้ (red 660 nm, green 532 nm, blue 473 nm)

กลไกการทำงานของพื้นผิวเมตาบนเมตาเลนส์

เมตาเลนส์ต้นแบบขนาดเส้นผ่านศูนย์กลาง 20 มิลลิเมตร ผลิตด้วยเทคโนโลยีนาโนอิมพรินต์ (nanoimprint lithography) ซึ่งเหมาะสมสำหรับการผลิตจำนวนมาก ต้นแบบที่ทำขึ้นมีประสิทธิภาพการส่งผ่านแสง co-polarized สูงถึงประมาณร้อยละ 79 ในช่วงสีแดง เขียว และน้ำเงิน แสดงถึงความสม่ำเสมอและกว้างช่วงความถี่ของการส่งผ่าน ส่วน cross-polarized มีประสิทธิภาพต่ำกว่าที่ประมาณร้อยละ 5-29 ซึ่งเป็นไปตามที่ออกแบบไว้เพื่อให้ภาพเสมือนชัดเจนแต่ไม่รบกวนการมองเห็นโลกจริง

ภาพจากกล้องจุลทรรศน์อิเล็กตรอนแสดงให้เห็นโครงสร้างระดับนาโนของเมตาเลนส์ที่ทำหน้าที่บิดและปรับรูปทรงของแสงเพื่อสร้างภาพ

ที่มาภาพ : Rmdigh, CC BY-SA 4.0 via Wikimedia Commons

นอกจากนี้ยังมีเทคโนโลยีอื่นที่ต่อไปจะควบรวมเป็นส่วนหนึ่งของระบบที่ทำให้เรามีประสบการณ์รู้สึกดื่มด่ำลงลึก (ภาษาอังกฤษเรียกว่า immersive experience หรือ dive) เข้าไปในโลกเสมือน ที่กำลังพัฒนาขึ้นเรื่อย ๆ ได้แก่

ระบบตอบสนองแบบสัมผัส (haptic system) ขั้นสูง เช่น มีการพัฒนาส้อมที่ให้การตอบสนองแบบสัมผัสผ่านตัวกระตุ้นด้วยคลื่นแม่เหล็กไฟฟ้า เพื่อเสริมสร้างประสบการณ์การกิน นอกจากนี้ยังมีการคิดค้นระบบเซนเซอร์ที่ยืดหยุ่นคล้ายผิวหนัง ซึ่งสร้างโอกาสใหม่ในการพัฒนาผลิตภัณฑ์เออาร์และวีอาร์ขั้นสูง อุปกรณ์เออาร์แบบสวมใส่ได้ เช่น หมวกกันน็อกเออาร์ที่ปรับให้เข้ากับงานเฉพาะที่ต้องการ

จอแสดงผลกลิ่น (olfactory display) ขนาดกะทัดรัด มีงานวิจัยที่นำเสนอ “จอแสดงผลกลิ่นแบบจับต้องได้สำหรับวีอาร์” รวมถึงการพัฒนาต้นแบบสร้อยคอแสดงผลกลิ่นที่ผู้วิจัยสร้างขึ้น เทคโนโลยีเหล่านี้มีศักยภาพในการขยายมิติทางประสาทสัมผัสของประสบการณ์ความเป็นจริงขยาย หรือเอกซ์อาร์ (extended reality: XR)

ชุดหูฟังเอกซ์อาร์ระดับไฮเอนด์ (เช่น Varjo XR-3) อุปกรณ์เหล่านี้มีความสามารถในการแสดงภาพที่ความละเอียดระดับสายตา ถ่ายทอดสภาพแวดล้อมของผู้ใช้ไปยังจอแสดงผลของชุดหูฟังโดยใช้การมองเห็นผ่านวิดีโอ ผ่านกล้องสเตอริโอในตัว ทำให้สร้างวัตถุเสมือนจริงที่ทึบแสงได้อย่างสมบูรณ์ โดยปิดบังวัตถุจริงในมุมมองความเป็นจริงผสมผสาน (mixed reality: MR)

สมาร์ตกลาส (smart glasses) เช่น Microsoft HoloLens และ Google Glass มีจอแสดงผลแบบโปร่งใสที่ซ้อนทับข้อมูลดิจิทัลบนมุมมองของผู้สวมใส่ และรวมเซนเซอร์ขั้นสูงสำหรับการติดตามและการโต้ตอบที่แม่นยำ

แท็บเล็ตและอุปกรณ์มือถือที่เปิดใช้งานเออาร์ ยังคงมีบทบาทสำคัญในการประเมินคุณภาพอาหาร โดยบูรณาการกับเซนเซอร์ไอโอที (IoT) เพื่อให้ข้อมูลเชิงลึกที่ครอบคลุมเกี่ยวกับคุณภาพอาหาร

ปัจจุบันความท้าทายหรือข้อจำกัดที่ต้องแก้ไขสำหรับอุปกรณ์ประเภทเอกซ์อาร์และเอ็มอาร์ก็คือ ปัญหาเรื่องความล้าของสายตาและอาการเมาจากการเคลื่อนไหว (motion sickness) รวมถึงความเป็นส่วนตัวของข้อมูลผู้ใช้ ต้นทุนของอุปกรณ์ยังสูง แต่ในอนาคตเราน่าจะได้เห็นอุปกรณ์ที่ขนาดเล็กหรือเบาบางลง และมีราคาถูกลง ปัญญาประดิษฐ์เองก็จะจัดการภาพในโลกเสมือนได้ดีและเป็นธรรมชาติมากยิ่งขึ้น เมตาเวิร์สจะเป็นเรื่องปกติที่เห็นในชีวิตประจำวันทั่วไปได้ เนื่องจากความเร็วของการถ่ายโอนข้อมูลที่เหนือกว่า 5G ที่เราใช้กันในปัจจุบันด้วยเช่นกันครับ

แหล่งข้อมูลอ้างอิง

- Shaker, L. M., Al-Amiery, A., Takriff, M. S., Wan Isahak, W. N. R., Mahdi, A. S., & Al-Azzawi, W. K. (2023). The future of vision: a review of electronic contact lenses technology. ACS Photonics, 10(6), 1671-1686.

- Zulkarnain, A. H. B., & Gere, A. (2025). Virtual Reality Sensory Analysis Approaches for Sustainable Food Production. Applied Food Research, 100780.

- Karhu, N., Rantala, J., Farooq, A., Sand, A., Pennanen, K., Lappi, J., … & Raisamo, R. (2025). The effects of haptic, visual and olfactory augmentations on food consumed while wearing an extended reality headset. Journal on Multimodal User Interfaces, 19(1), 37-55.

- Bock, L., Bohné, T., & Tadeja, S. K. (2024). Decision support for augmented reality-based assistance systems deployment in industrial settings. Multimedia Tools and Applications, 1-25.

- Zhou, Z., Oveissi, F., & Langrish, T. (2024). Applications of augmented reality (AR) in chemical engineering education: Virtual laboratory work demonstration to digital twin development. Computers & Chemical Engineering, 188, 108784.

- Protogeros, G., Protogerou, A., Pachni-Tsitiridou, O., Mifsud, R. G., Fouskas, K., Katsaros, G., … & Valdramidis, V. (2025). Conceptualizing and advancing on Extended Reality applications in food science and technology. Journal of Food Engineering, 396, 112557.

- Takaki, Y. (2023). Future of AR display: Holographic contact lens. JSAP Review, 2023, 230304.

- Abdulamier, A. A., Shaker, L. M., Al-Amiery, A. A., Qasim, M. T., Isahak, W. N. R. W., & Luthfi, A. A. I. (2024). Advancements and applications of smart contact lenses: A comprehensive review. Results in Engineering, 24, 103268.

- Lee, G. Y., Hong, J. Y., Hwang, S., Moon, S., Kang, H., Jeon, S., … & Lee, B. (2018). Metasurface eyepiece for augmented reality. Nature communications, 9(1), 4562.

- Yao, G., Li, P., Liu, M., Liao, F., & Lin, Y. (2024). Smart contact lenses: Catalysts for science fiction becoming reality. The Innovation, 5(6).

- Shaker, L. M., Al-Amiery, A., Isahak, W. N. R. W., & Al-Azzawi, W. K. (2023). Metasurface contact lenses: A futuristic leap in vision enhancement. Journal of Optics, 1-16.